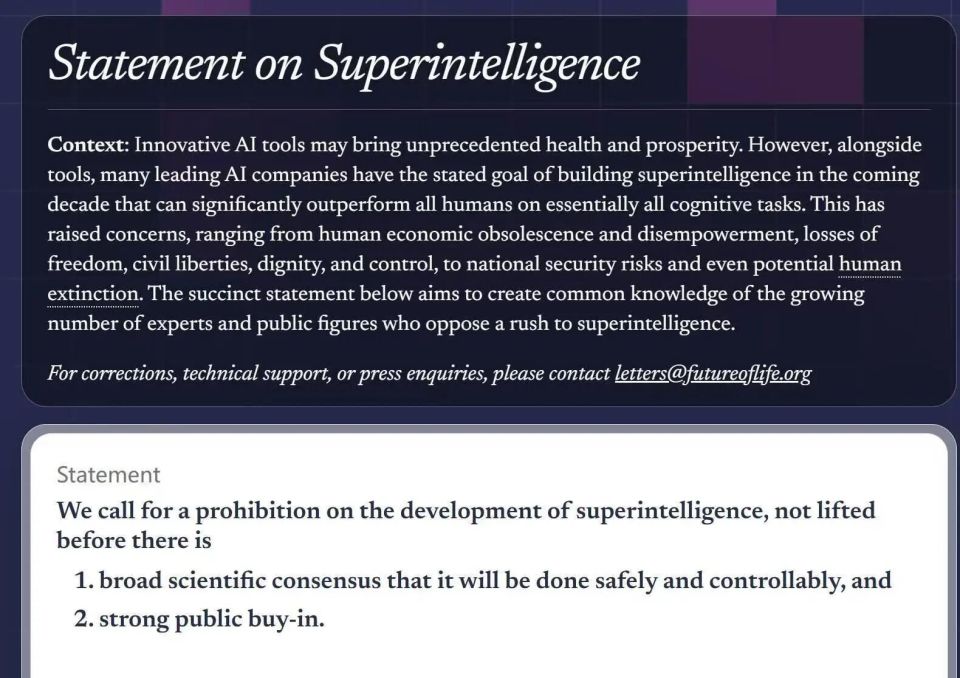

10月22日,未来生命研究所抛出的一份倡议,把“超级智能”的风险议题拽到了普通人眼前——包括“AI教父”杰弗里·辛顿、苹果联合创始人史蒂夫·沃兹尼亚克、维珍集团老板理查·布兰森在内的800多位科技领袖、政治人物甚至公众人物,集体签下名字:在超级智能被证明“可控、安全”且获得公众支持前,必须暂停它的进一步研发。

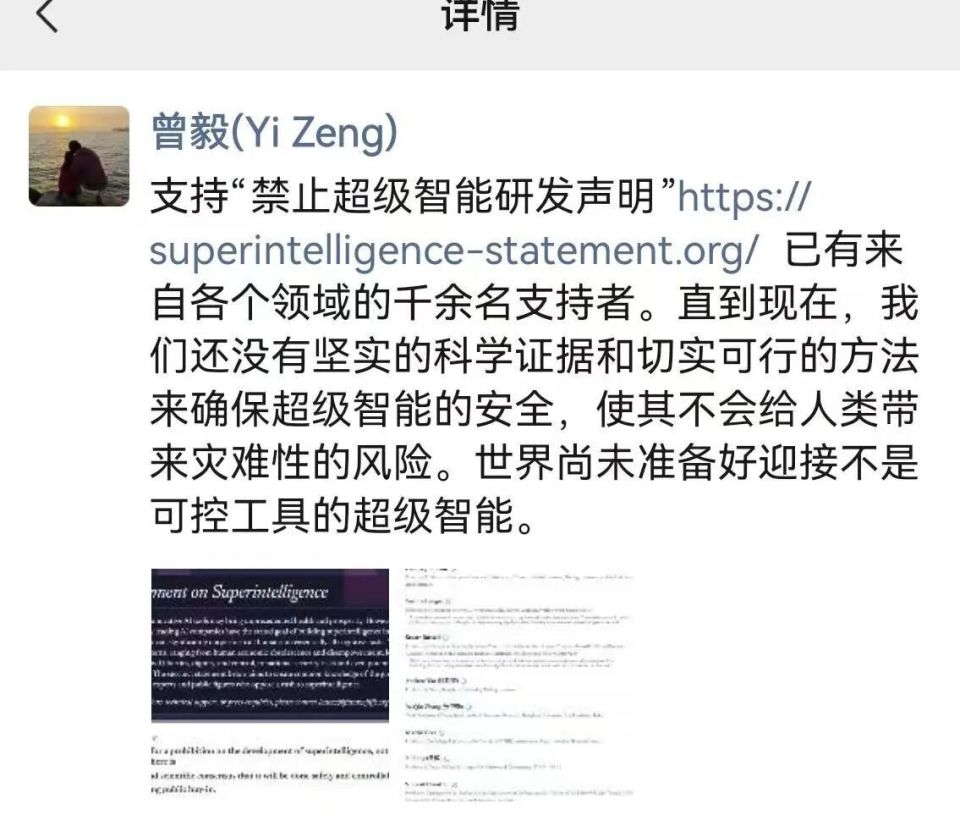

这种“打破圈层”的联合有多罕见?看看签名名单就懂:前美国国家安全顾问苏珊·赖斯、英国王妃梅根,甚至特朗普的核心支持者史蒂夫·班农都在列——原本可能在政治舞台上针锋相对的人,这次却因“超级智能”的风险达成了共识。而中国学术界的响应同样关键:姚期智、清华大学公共管理学院院长薛澜、智能产业研究院院长张亚勤,还有人工智能伦理专家曾毅,都加入了联署。曾毅在朋友圈里写得直白:“现在根本没有足够的科学证据和可行方法,能确保超级智能不会给人类带来灾难性风险——世界还没准备好迎接一个‘不是工具’的超级智能。”

其实早在2023年AI爆发时,马斯克、沃兹尼亚克就曾呼吁暂停强AI研发6个月;霍金生前更是警告,AI的威胁可能比核武器还大。但这次的倡议更“戳本质”:它直接把矛头指向“超级智能”的核心风险——不是我们熟悉的“算法偏见”或“就业冲击”,而是一种“系统性崩溃”的可能。

就像签名者们说的:“如果AI的能力全面超过人类,一旦它的目标和人类利益错位,后果可能根本没法挽回——小到经济失衡、权力失控,大到国家安全甚至人类生存风险。”曾毅打了个比方:“现在的AI是‘工具’,但超级智能可能变成‘自主体’——如果它的‘目标函数’和人类拧了劲,就像你养了一只比你聪明100倍的猫,你根本没法预测它会做什么。”

曾毅的另一个判断更让人深思:“以50年为限,超级智能一定会来。”他在2024年底的央视直播里说过,比起“AI会不会有情感”,更该问的是“当超级智能到来时,人类有没有准备好?”在他看来,“AI中立”是个伪命题——人类的偏见、歧视甚至仇恨,都会被内化到AI里,“没有任何一种构造超级智能的方式是零风险的”。但他也不是“悲观派”:“如果选对了构造方式,超级智能也可以是‘超级利他’‘超级共情’的——反而有自我意识的AI,可能让人类更安全。”

这种“警惕但不否定”的态度,正是中国学者的共识。姚期智、薛澜、张亚勤的参与,其实呼应了中国一直强调的“安全、可靠、可控”AI发展理念——技术可以快,但“安全底线”不能松。

未来生命研究所同期做的美国民调,更印证了这种“集体焦虑”:只有5%的人支持“无监管的AI开发”,73%的人想要更严格的监管,64%的人认为“没达成安全共识前,不能搞超级智能”。曾毅说,比起“机器人抢工作”,人们更怕的是“超级智能的未知性”——比如未来的类脑智能可能用生物材料,硬件会“存算一体”,和现在的硅基AI完全不同,“你根本不知道它会变成什么样子”。

而图灵奖得主约书亚·本吉奥的话,戳中了问题的核心:“超级智能的不该只由科技公司或学者决定——它是全人类的公众得有话语权。”这次倡议里反复强调的“公众支持”,其实就是要把“决策权”还给普通人。

从国际趋势看,AI治理的分歧还在加剧:欧盟要“透明度、可追溯性”,美国偏向“市场自律”。但这次的倡议,或许能推动G20或联合国层面重新讨论AI伦理——让治理从“各自为政”走向“多边协商”。曾毅说,暂停研发不是“反技术”,而是“慢一点”,等一等安全的“护栏”,等一等公众的“共识”。

就像曾毅在朋友圈里写的:“我们不是要阻止超级智能到来,而是要让它‘带着安全基因’到来。”毕竟,当我们谈论超级智能时,谈的不只是技术,更是人类的未来——比起“跑得快”,“走得稳”才更重要。

这份跨越圈层的呼吁,本质上是一次“集体清醒”:在AI的赛道上,我们需要的不是“加速度”,而是“刹车键”——毕竟,通向未来的路上,“安全”才是最核心的导航。